Ce lundi, YouTube a révélé sur son blog officiel son rapport trimestriel sur la modération. Ainsi, plus de 8 millions de vidéos ont été supprimées de la plateforme d’octobre à décembre 2017. YouTube précise d’ailleurs sur son rapport que « La majeure partie de ces 8 millions de vidéos était principalement composée de spams ou de personnes qui tentaient de télécharger des contenus pour adultes ».

L’aide des machines à la modération

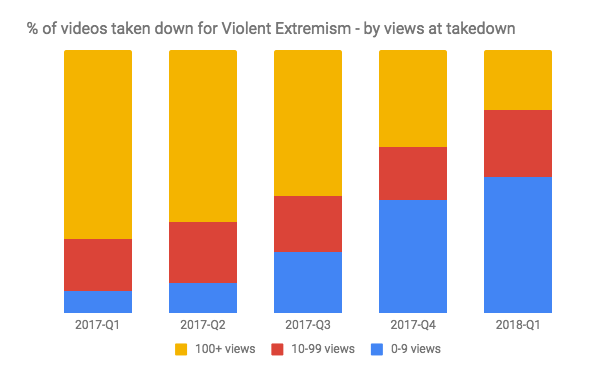

La vraie nouveauté du quatrième trimestre 2017 vient de l’importance de l’intelligence artificielle dans la modération. En effet, YouTube a fièrement indiqué qu’une large partie des 8 millions de vidéos supprimées, 6,7 millions avaient été signalés automatiquement par une machine. Mieux, 76 % d’entre elles, soit environ 5 millions, ont pu être supprimées avant d’enregistrer la moindre vue.

Répartition des vidéos bannies par YouTube pour apologie d’extrémisme violent par nombre de vues et par trimestre. Source : blog officiel de YouTube.

Google entend bien continuer ses efforts au niveau de la modération automatique sur YouTube, notamment en améliorant son outil de signalement de contenu indésirable. Chaque utilisateur peut d’ailleurs désormais consulter l’état des signalements qu’il a effectués en consultant le tableau de bord dédié.

Pour rappel, YouTube lutte également activement contre les théories du complot qui circulent sur sa plateforme.